TAG:量化压缩

腾讯开源超轻量离线翻译模型,手机端运行仅需0.4GB内存

腾讯混元团队开源超轻量离线翻译模型Hy-MT1.5-1.8B-1.25bit,将33种语言翻译能力压缩至约440MB,可在手机端断网运行。文章重点介绍其量化压缩技术、实测性能、隐私优势及多场景落地价值。

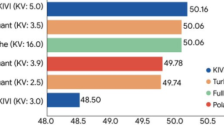

谷歌 TurboQuant 发布:LLM 键值缓存压缩六倍速度提升八倍 零精度损失无需训练

谷歌研究团队发布全新向量量化算法 TurboQuant,通过 PolarQuant 与 QJL 技术实现 LLM 键值缓存内存压缩6倍、推理速度提升8倍,零精度损失且无需训练。该技术可显著降低 AI 推理成本,推动长上下文应用落地,适用于广泛场景。

达卯科技携手湖南红太阳新能源,以“硬件+AI”打造能源数字化全球落地新范式

2026-04-30

0 浏览

当“AI”成为新消费引擎,中国移动咪咕亮出“智能经济”硬核实力

2026-04-30

0 浏览

SAS推出企业级AI治理工具,全面管控智能体以化解影子AI风险

2026-04-30

0 浏览

谷歌相册上线 AI 衣橱管家,支持一键提取单品和虚拟试穿

2026-04-30

0 浏览

特斯拉 Semi 电动卡车首辆量产车下线,历时九年研发

2026-04-30

0 浏览

三星电子单季净利暴增487%,李氏家族财富翻倍至3112亿元居亚洲第三

2026-04-30

0 浏览

三星 Galaxy Glasses 智能眼镜曝光:搭载骁龙 AR1 芯片、配备 1200 万像素相机,重约 50 克

2026-04-30

0 浏览

零犀科技凭借因果大模型打破AI商业化瓶颈并实现规模化盈利

2026-04-30

0 浏览

消息称苹果 iOS 27 相机将新增 Siri 模式,可通过 AI 记录食品标签、名片和活动门票

2026-04-30

0 浏览

韦德担任“陪练”,追觅扫地机在硅谷上演极限避障测试

2026-04-30

0 浏览