TAG:模型优化

DeepSeek 发布突破性研究:架构优化显著提升AI推理能力

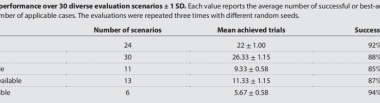

DeepSeek最新研究揭示,通过优化神经网络架构而非单纯扩大模型规模,可显著提升大语言模型的推理能力。其提出的“流形约束超连接”方法解决了信号传播不稳定问题,在多项基准测试中实现性能突破,同时仅增加约6%-7%的训练开销,为AI发展提供了高效且经济的新路径。

DeepSeek双模型重磅开源 长文本与深度思考能力再突破

DeepSeek发布V3.2双模型,标准版在128k上下文场景下与GPT-5互有胜负,深度思考版在多项基准测试中与Gemini3Pro打平。核心升级转正稀疏注意力(DSA)将长文本计算复杂度降至线性,显存占用下降40%,推理速度提升2.2倍,首次实现开源模型百万token单卡推理。模型已开源并允许商业化,下一步将开源DSA内核与RL训练框架,推动开源阵营在长文本与推理能力上冲击领先地位。

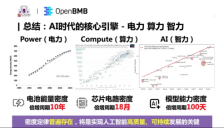

清华新发现:AI大模型不止看“块头”,更要重视密度

清华大学在《自然・机器智能》发表研究,提出AI大模型评估新概念“能力密度”,强调不应仅关注参数规模,而需重视每个参数的智能水平。研究发现能力密度正以每3.5个月翻倍的速度增长,未来小体积模型将实现更高性能。这项突破推动AI向精炼高效发展,已成功应用于手机、汽车等智能设备领域。

AI振兴网络视听每一帧,但人仍是不可替代的灵魂

2026-04-15

0 浏览

中国工程院院士郑纬民:从模型服务走向词元服务,是智能体时代对基础设施的必然要求

2026-04-15

0 浏览

微软接手OpenAI挪威星际之门项目 加码AI算力布局

2026-04-15

0 浏览

让AI帮忙买保险结果付款给了陌生人?每经记者亲测:通用AI和保险AI用谁买保险更靠谱

2026-04-15

0 浏览

爱奇艺创始人、首席执行官龚宇:期待AI生成的高品质影视作品

2026-04-15

0 浏览

激进投资者施压叠加AI效率提升 Snap启动16%裁员计划 股价盘前大涨11%

2026-04-15

0 浏览

地平线副总裁吕鹏:物理AI时代需打造超级平台,舱驾融合是智能电动2026发展方向

2026-04-15

0 浏览

加纳驻华大使携手APUS签署战略合作,启动KOJO BONSU GEN Z AI CLUB

2026-04-15

0 浏览

AI时代背景下初高中学习:真人老师与AI工具谁更能提升学习效果

2026-04-15

0 浏览

佰维存储Q1净利28.99亿元实现扭亏为盈 AI端侧存储收入增近5倍

2026-04-15

0 浏览